Obsah:

Dobrý den, čtenáři blogu Botland! Zpívá někdo z vás, tančí nebo tančí a zpívá? Máte nějakého oblíbeného zpěváka, kterého byste si rád zahrál, třeba v nějakém oblíbeném seriálu? Žádný problém! Zde je deepfake – plod technologie umělé inteligence, který je mnohem přesvědčivější než i ty nejlepší dosud vytvořené fotomontáže. Jen… je vždy možné hrát si s něčí identitou?

Co je to deepfake? Kořeny myšlenky - CGI

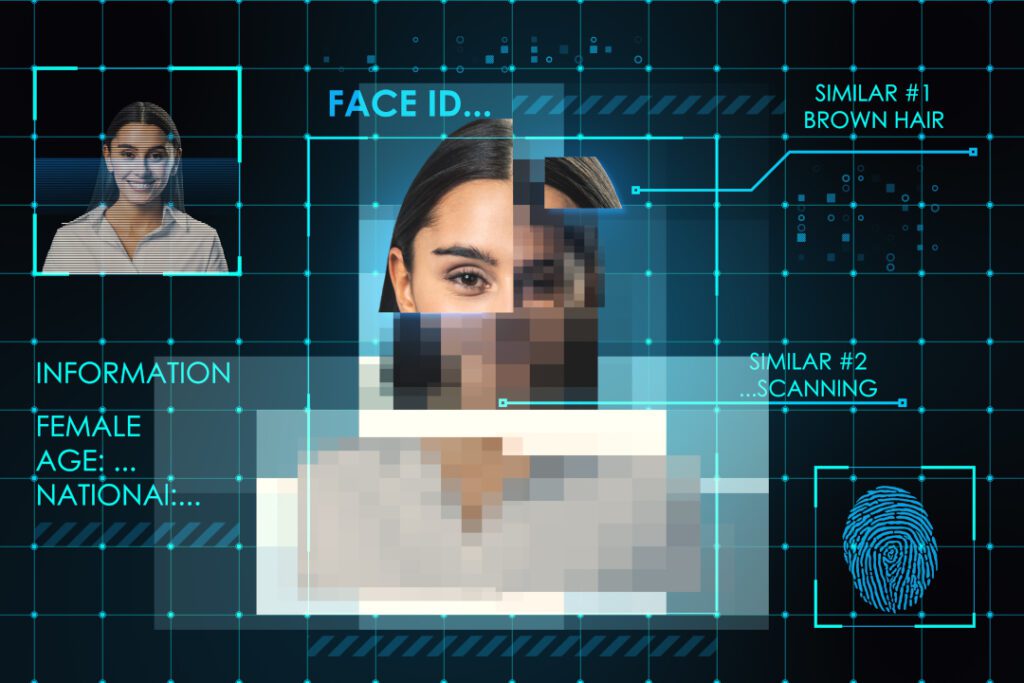

Deepfakes využívají umělou inteligenci založenou na hlubokém učení k nahrazení podoby jedné osoby jinou ve videu a dalších digitálních médiích. Počítače jsou v simulaci reality stále lepší a lepší. Tento koncept existuje již dlouho a “záměna obličeje” byla předmětem mnoha fanouškovských fotomontáží a photoshopových obrázků.

Moderní kinematografie se ve velké míře spoléhá na počítačové efekty, které nahrazují skutečné postavy, scenérie nebo rekvizity. Dobře vytvořené scény jsou pro netrénované oko často k nerozeznání od reality. Jde o to, že je neuvěřitelně obtížné vytvořit přesvědčivý obraz pomocí CGI neboli počítačem generovaného obrazu. Největší potíže nejsou ani tak v akčních scénách, ale v efektech stárnutí a reprodukci výrazů tváře.

Už nežijeme v éře kinematografie, kde střílečky létaly na provázcích jako čarodějové, ale stále se setkáváme s monstry, jako je lepkavý plaz v Mortal Kombat: Zkáza (1997), jaderný výbuch ledničky v Indiana Jonesovi a Království křišťálové lebky (2008) nebo nehorázně umělý tygr v seriálu The Walking Dead (2010-2021).

Co dělá deepfake? Kořeny pojmu – deep learning

Termín “deepfake” pochází ze základní technologie deep learning neboli hlubokého učení, která vznikla na základě práce na umělé inteligenci. Algoritmy hlubokého učení, které se učí řešit problémy z velkých souborů dat, lze úspěšně použít k přesvědčivému nahrazení tváří ve videozáznamech. A protože v lidském obličeji je asi 70 inervovaných svalů, rozhodně to není snadný úkol.

Technologie Deepfake se zdá být relativně nová, ale její počátky jsou mnohem starší. Již v devadesátých letech minulého století ji vyvíjeli vědci v akademických institucích. Právě v 70. letech 20. století přešel později takříkajíc do rukou amatérů a nadšenců v online komunitách. Kolem roku 2017 začaly tuto technologii využívat korporace, ziskové organizace, individuální tvůrci a konečně i zábavní průmysl. Podle některých názorů začal vynález deepfakes v roce 1997 s programem Video Rewrite. Software dokázal upravit existující videa, na kterých byl řečník zobrazen. Po umístění zvukového překryvu přes původní video se zdálo, že osoba mluví slova nové skladby se správnou synchronizací rtů. Tato technika byla založena na strojovém učení. Po počátečním zájmu o deepfake mediální obsah bylo jejich využití v reálném světě spíše omezené.

Moderní deepfake. Kořeny popularity - Reddit a online komunity

V posledních letech se svět deepfakes rozjel jako klasický internetový virál. Slovo “deepfake” poprvé použil v roce 2017 stejnojmenný uživatel Redditu. Uživatelé na platformě sdíleli různý obsah, nejčastěji deepfake videa s dospělými celebritami, které využívaly open source technologii facewap.

Proč tato rostoucí obliba? První důvod spočívá v okázalé prezentaci toho, čeho je umělá inteligence schopna, a druhý… v lidských instinktech. Deepfakes vznikly jako vedlejší produkt algoritmů hlubokého učení a vývoje umělé inteligence.

Technologie Deepfake byla přenesena především do zábavního průmyslu, zejména do obsahu pro dospělé a filmových parodií. Deepfakes jsou skvělým příkladem toho, čeho je dnes umělá inteligence schopná a jak se formuje reálný a digitální svět kolem nás. V době, kdy je společnost neoddělitelně spjata se sociálními médii, umožňují deepfakes zaplnit kreativní mezery. Koneckonců deepfake umožňuje tvůrci kdykoli přimět kohokoli, aby řekl cokoli. Jedná se tedy o nástroj, který dává uživateli velkou moc. A s mocí je to jako s mocí – lze ji využít k dobrým i špatným účelům.

Jak vytvoříte deepfake?

Oblíbené rčení říká, že pokud něco existuje, existuje na to aplikace. Na základě popularity deepfakes samozřejmě vzniklo množství bezplatných i placených aplikací, které umožňují rychlou změnu vzhledu. Efekty jsou spíše průměrné a šíří se hlavně jako obsah zaslaný mezi přáteli jako vtip. Mezi takové aplikace a programy patří například čínská aplikace Zao, DeepFace Lab, FaceApp (pro úpravu fotografií se zabudovanými technikami umělé inteligence) nebo Face Swap. Mnoho aplikací již bylo odstraněno, protože byly považovány za nebezpečné, ale lze vůbec aplikace, které používají přesvědčivou simulaci něčího obličeje, považovat za bezpečné? Na internetu se stále častěji objevují zprávy o tom, že zločinci k vytváření falešných kopií používají také ukradené obrázky a přihlašovací údaje nalezené na deepwebu. O nebezpečí těchto praktik jsme již psali.

Nejčastěji používaná metoda zahrnuje použití hlubokých neuronových sítí zahrnujících autoenkodéry s technikou výměny tváří. Potřebujete cílové video, které bude sloužit jako základ deepfake, a také sbírku videoklipů osoby, kterou chcete do materiálu zahrnout. Zajímavé je, že tato videa mohou být zcela nesouvisející – cílem může být například úryvek z hollywoodského trháku a videa osoby, kterou do něj chcete vložit, mohou být náhodné klipy stažené z YouTube. Autoenkodér jako program umělé inteligence s hlubokým učením bude studovat klipy, aby pochopil, jak osoba vypadá z různých perspektiv a za různých podmínek prostředí, a poté je zmapuje z cílového videa nalezením společných rysů. Dalším typem strojového učení, známým jako Generative Adversarial Networks (GAN), jsou generativní koadverzní sítě. GAN odhalují a opravují případné chyby v deepfake v průběhu mnoha pokusů, a to zase znesnadňuje jejich dešifrování detektory deepfake.

Důsledky deepfakes

Mnozí odborníci se domnívají, že v budoucnu, s dalším vývojem technologií, budou deepfakes mnohem sofistikovanější a stanou se zdrojem mnoha sociálních hrozeb. Zmíněny jsou zásahy do voleb, politické napětí a trestná činnost. Mohou však být nástroje špatné, nebo spíše jen ty, které je používají určitým způsobem? Nůž, který byl vynalezen před více než 12 000 lety, se používá současně k zabíjení, krájení potravin i k chirurgickým zákrokům. V kuchyňském noži není žádná morálka – není ze své podstaty dobrý ani špatný. Původci deepfakes jistě chtěli, aby se tato technologie používala hlavně pro tvorbu zábavy a umění. Bohužel se používá i pro praxi tzv. krádeže identity a padělání. Stejně jako každý typ nože nás může zklamat a omylem pořezat kůži, i deepfakes mají znepokojivý potenciál způsobit vážné poškození. Volbu mezi optimistickou a pesimistickou variantou prognóz vývoje technologie deepfake ponecháváme na vás.

Jak hodnotíte tento článek na blogu?

Klikněte na hvězdičku a ohodnoťte!

Průměrné hodnocení 4.8 / 5. Počet hlasů 4

Zatím nejsou žádné hlasy! Buďte první, kdo ohodnotí tento článek.